在深度学习的浪潮中,卷积神经网络(CNN)无疑是计算机视觉领域的基石。当我们谈论CNN时,两个核心组件总是绕不开:卷积层和全连接层。它们就像一支精密团队中的两位专家,各司其职,又紧密协作。简单来说,卷积层是“特征侦察兵”,负责从原始数据中提取局部特征;而全连接层是“决策指挥官”,负责整合所有信息,做出最终判断。

一、卷积层:网络的“眼睛”,专注于局部特征

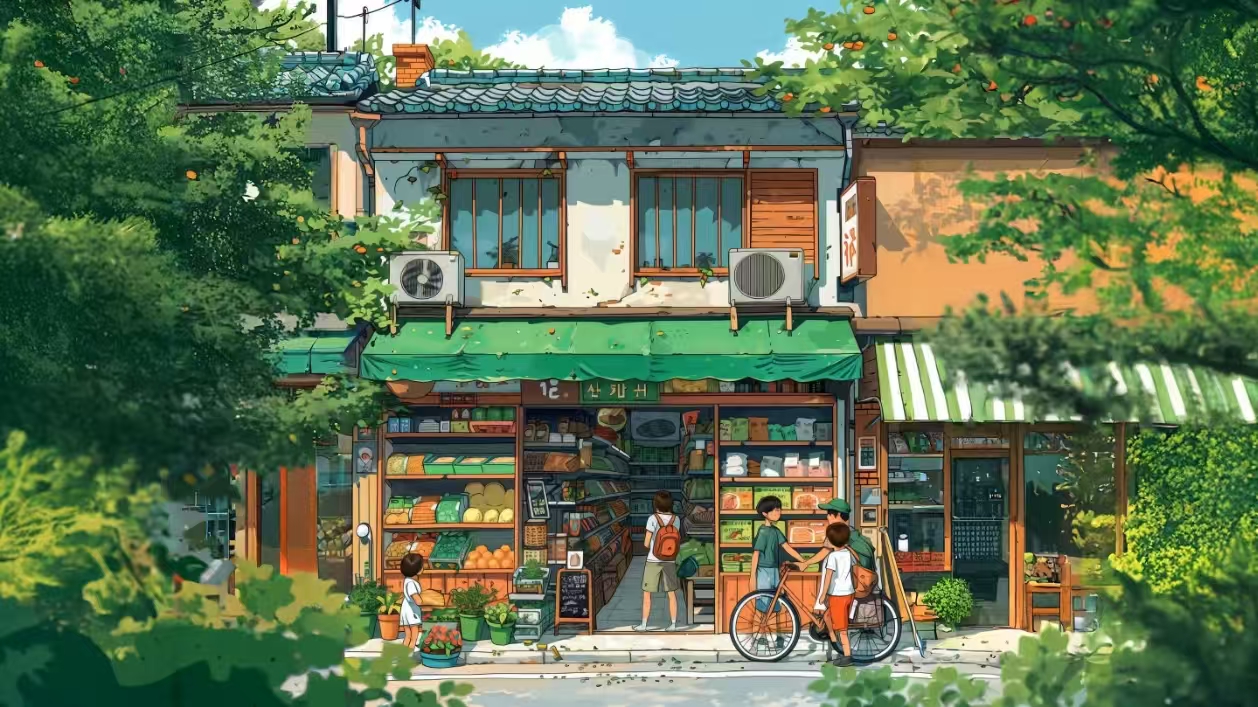

想象一下,当你识别一只猫时,你的眼睛并不会一次性“看”完整个猫的图像,然后得出“这是猫”的结论。相反,你会先注意到一些局部特征:尖尖的耳朵、圆溜溜的眼睛、毛茸茸的尾巴。卷积层的工作方式与此惊人地相似。

1.1 卷积操作的本质

卷积层的核心是一个(或多个)称为卷积核或滤波器的小型矩阵。这个滤波器在输入图像(或上一层的特征图)上“滑动”,进行一种称为卷积的数学运算。

# 一个简单的卷积运算示例(概念性代码)import numpy as np

# 假设一个简单的3x3图像input_image = np.array([[1, 0, 1], [0, 1, 0], [1, 0, 1]])

# 一个用于检测边缘的3x3卷积核kernel = np.array([[ 1, 0, -1], [ 0, 0, 0], [-1, 0, 1]])

# 卷积运算(简化版,忽略步长和填充)output = np.sum(input_image * kernel) # 结果为 0,表示该区域没有强边缘这个滑动和计算的过程,就是在不断地询问:“我的输入数据的这个局部区域,是否具有卷积核所代表的某种模式(如边缘、角点、纹理)?” 如果匹配度高,输出的特征图上对应位置的值就会很大。

1.2 卷积层的核心优势

卷积层之所以成为处理图像、语音、文本等网格化数据的利器,源于其三大先天优势:

- 局部连接:每个神经元只与输入数据的一个小区域(感受野)相连。这大大减少了参数数量,符合“图像中相邻像素关联性强”的直觉。

- 权重共享:同一个卷积核在整个输入上滑动并重复使用。这意味着无论边缘出现在图像的左上角还是右下角,都由同一个“边缘检测器”来识别。这极大地提升了模型的效率和平移不变性。

- 层次化特征提取:浅层的卷积核通常学习到的是基础特征(如边缘、颜色、纹理)。 随着网络加深,这些基础特征被组合成更复杂的模式(如眼睛、轮子、窗户)。 最终,高层卷积层能捕捉到近乎语义的概念(如“猫脸”、“车身”)。

关键洞察:卷积层并不“理解”图像中是一个完整的物体。它只是高效地、分层地报告“在哪里发现了什么样的局部模式”。它就像无数双专注的“眼睛”,各自报告自己看到的一小部分线索。

二、全连接层:网络的“大脑”,负责全局决策

如果卷积层是散布在各处的侦察兵,那么全连接层就是位于后方的指挥中心。侦察兵们(卷积层)将收集到的所有局部情报(特征图)汇总到这里,由指挥中心进行综合分析,做出最终的战略决策(分类或回归)。

2.1 从特征空间到决策空间

经过一系列卷积和池化操作后,我们得到了一组高维的特征图。全连接层的第一项工作,就是将这些空间结构展平成一个长向量。这个向量包含了网络从输入中提取的所有“证据”。

# 展平操作示例# 假设最后一个卷积层输出形状为 [batch_size, channels, height, width] = [1, 512, 7, 7]flattened_vector = feature_maps.reshape(1, -1) # 形状变为 [1, 512*7*7] = [1, 25088]接下来,这个包含25088个特征的向量被送入一个或多个全连接层。在这里,每个神经元都与上一层的所有神经元相连。这正是“全连接”的含义。它允许网络学习特征之间任意复杂的非线性组合。

2.2 全连接层的作用解析

- 特征整合与加权:全连接层学习每个特征对最终任务的重要性权重。例如,在猫狗分类中,“胡须特征”的权重可能很高,而“背景草地特征”的权重可能很低。

- 非线性映射:配合激活函数(如ReLU),全连接层能将整合后的特征映射到新的高维空间,使得不同类别在最终空间里更容易被一个超平面(由最后的输出层实现)分开。

- 最终决策:通常,最后一个全连接层的输出神经元数量等于目标类别数(如10类分类任务就是10个神经元)。每个神经元的激活值代表了网络认为输入属于该类别的“得分”或“概率”。

:::important 全连接层 vs. 卷积层:思维模式的差异 卷积层的思维是:“这个局部像什么?” 它是自下而上、由局部到整体的。 全连接层的思维是:“综合考虑所有线索,它最可能是什么?” 它是全局的、综合性的。 :::

三、协同作战:一个经典的CNN架构剖析

让我们以经典的LeNet-5网络(用于手写数字识别)为例,看看两者如何配合:

- 输入层:28x28的灰度图像。

- 卷积层 C1:使用6个5x5的卷积核,提取6种不同的基础特征(如不同方向的笔画)。输出6张特征图。

- 池化层 S2:下采样,保留主要特征,降低维度。

- 卷积层 C3:使用更多卷积核,组合基础特征形成更复杂的形状(如数字的弧圈、交叉)。

- 池化层 S4:再次下采样。

- 全连接层 F5:将最后的特征图展平,送入拥有120个神经元的全连接层。这里开始整合所有高级特征。

- 全连接层 F6:84个神经元,进一步抽象和整合。

- 输出层:10个神经元(对应数字0-9),使用Softmax函数输出每个类别的概率。

在这个流程中,前面的卷积部分(C1, S2, C3, S4)构成了强大的特征提取器,而后面的全连接部分(F5, F6, 输出层)则构成了分类器。

TIP现代网络架构(如VGG, ResNet)在最后往往使用全局平均池化 替代一个或多个全连接层,直接将每个特征图的空间维度池化为一个值。这能显著减少参数,防止过拟合,但其思想内核依然是“整合所有空间位置的信息”,可以看作是全连接思想的一种更高效的实现。

四、演变与趋势:全连接层地位的变化

在早期的CNN中,全连接层参数量巨大,常常占整个网络参数的80%以上,是容易导致过拟合的“重灾区”。因此,网络设计中出现了一些趋势来优化或替代它:

- 使用Dropout:在全连接层中随机“丢弃”一部分神经元,是一种行之有效的正则化方法,强迫网络不依赖于少数特定的特征。

- 全局平均池化:如前所述,直接用每个特征图的平均值作为输出,省去了庞大的全连接权重矩阵。

- 全卷积网络:在语义分割等任务中,网络甚至完全摒弃了全连接层,全部由卷积层构成,使网络可以接受任意尺寸的输入。

然而,这并不意味着全连接层被淘汰了。在许多分类网络的头部,一个或两个轻量级的全连接层仍然是整合全局信息、完成分类决策的简洁有效方式。

总结:相辅相成,缺一不可

回到我们最初的类比:

- 卷积层是“眼睛”,它高效、专注,善于捕捉局部细节和空间模式,但视野有限。

- 全连接层是“大脑”,它广纳信息,善于推理、权衡和决策,但若没有“眼睛”提供优质特征,便是“巧妇难为无米之炊”。

它们的关系揭示了深度学习模型设计的一个核心哲学:分工与协作。卷积层负责将高维、冗余的原始数据(如图像像素)压缩、提炼为富有表现力的中级特征;全连接层则在这些特征的基础上,完成任务驱动的最终抽象与映射。理解这两者的区别与联系,是打开卷积神经网络大门,进而设计更高效、更强大模型的关键第一步。

部分信息可能已经过时

皖公网安备34040002000580号

皖公网安备34040002000580号